一次曝 9 个大模型,「字节 AI」这一年都在做什么?

一次曝 9 个大模型,「字节 AI」这一年都在做什么?

整个 2023 年,字节并没有对外官宣其内部自研的大模型。外界一度认为,大模型这一技术变革,字节入场晚了。梁汝波在去年底的年会上也提到了这一点,他表示「字节对技术的敏感度不如创业公司,直到 2023 年才开始讨论 GPT。」

尽管如此,字节做大模型和 AI 应用的消息不断。

2023 年 8 月 31 日,国内首批大模型产品通过《生成式人工智能服务管理暂行办法》备案,字节跳动云雀大模型赫然在列。同一时间,字节被爆出成立了新 AI 部门—— Flow,聚集了字节集团最能打的一批人才探索 AI 应用。过去大半年,字节跳动推出的 AI 应用几乎涵盖了所有热门赛道,豆包、扣子是最具代表性的两款。

5 月 15 日,在火山引擎原动力大会上,字节跳动首次揭开了上述自研大模型和 AI 应用神秘面纱的一角:豆包大模型(原云雀大模型)家族首次亮相,其大模型产品——「豆包 App」和 AI 应用产品——「扣子」也首次对外详细阐述。

火山引擎是字节跳动旗下云服务平台,据火山引擎总裁谭待介绍,经过一年时间的迭代和市场验证,字节自研大模型——豆包大模型(原云雀大模型)正成为国内使用量最大、应用场景最丰富的大模型之一,目前日均处理 1200 亿 Tokens 文本,生成 3000 万张图片。

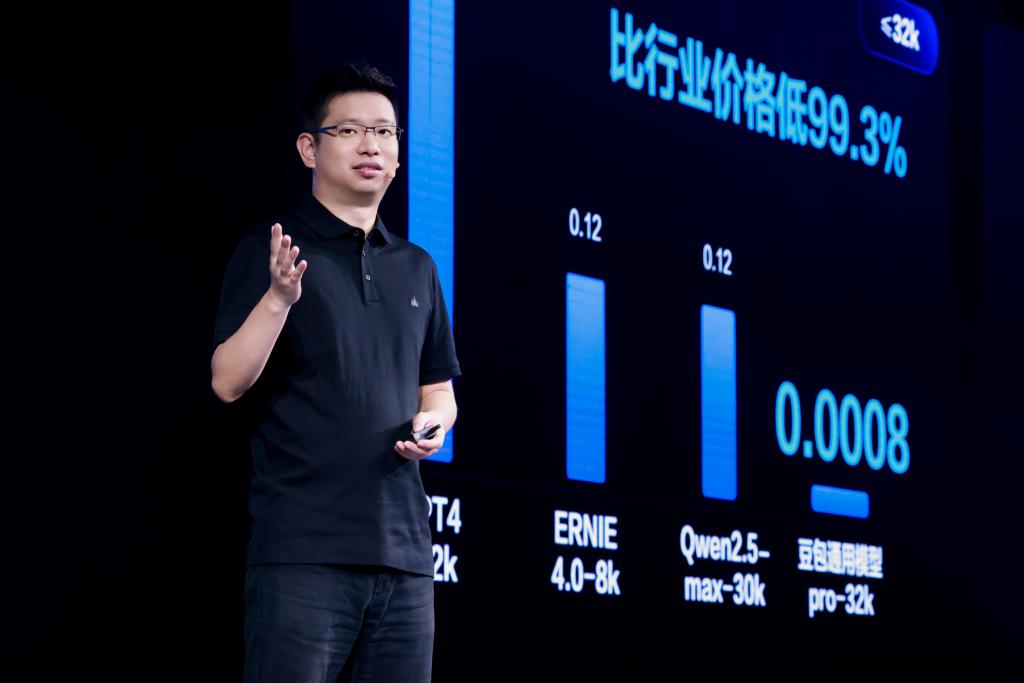

就豆包大模型而言,模型推理价格成为一大亮点,这也是近两周以来模型厂商重点发力传播的方向。谭待表示,大模型从以分计价到以厘计价,将助力企业以更低成本加速业务创新。

当前,豆包大模型大幅降低了模型推理的单位成本,其主力模型在企业市场的定价只有 0.0008 元 / 千 Tokens,0.8 厘就能处理 1500 多个汉字,比行业便宜 99.3%。

除了模型产品本身,更值得关注的是:字节跳动对大模型和 AI 产品的思考。

豆包大模型家族的成员,为什么当前有这九个?

模型产品「豆包 APP」、应用产品「扣子」作为字节跳动当前最主力的两款应用,背后是怎么思考的?

火山引擎作为云平台,在新时代的「野心」是什么?

在这场发布会上,这些问题也都得到了回应。

01 9 个模型,豆包大模型家族首次亮相

今年的 AI 发布会,大模型厂商都不再只聚焦在基座大模型本身,而是模型、工具、应用全面推出。显然,大模型落地,更进一步。

字节跳动也是如此,在火山引擎原动力发布会上,正式发布了字节跳动豆包大模型家族、火山方舟 2.0、AI 应用及 AI 云基础设施等一系列最新产品。

先来看模型,当前大模型行业的两大进化方向分别是价格和性能:模型推理价格进一步降低,模型性能进一步提升。在这两个方向上,豆包大模型家族,有自己的特点。

火山引擎总裁谭待公布豆包大模型定价|图片来源:火山引擎

火山引擎方面称,在模型价格上,豆包主力模型在企业市场的定价是 0.0008 元 / 千 tokens,0.8 厘就能处理 1,500 多个汉字,比行业便宜 99.3%。

谭待认为,降低成本是推动大模型快进到「价值创造阶段」的一个关键因素。在被问及「把价格压得这么低,是否亏钱补贴」时,谭待称,「ToB 业务亏损换收入不可持续,火山引擎从来不走这条路。能做到降低推理价格,有一系列技术手段,未来还能做得更好」,比如优化模型结构和工程手段上通过分布式推理来替代单机推理。

在模型性能上,「豆包大模型家族」根据市场需求,带着 9 个模型亮相,主要包括通用模型 pro、通用模型 lite、语音识别模型、语音合成模型、文生图模型等九款模型。

当前阶段之所以收敛到这九个大模型,字节跳动根据后台模型调用量和需求而来。

谭待向极客公园表示,首先要有一个最强的主力模型,能支持高级功能;其次是分场景或者端侧对低延迟要求很高,所以也需要豆包 lite;也需要性能和低延迟折中的模型;还有一些大的垂直场景里的模型,比如娱乐产品角色扮演,「大概率不需要它编程,但需要加强互动娱乐性」。

豆包大模型家族|图片来源:字节跳动

豆包通用模型 pro:字节跳动自研 LLM 模型专业版,支持 128k 长文本,全系列可精调,具备更强的理解、生成、逻辑等综合能力,适配问答、总结、创作、分类等丰富场景;

豆包通用模型 lite:字节跳动自研 LLM 模型轻量版,对比专业版提供更低 token 成本、更低延迟,为企业提供灵活经济的模型选择;

豆包 · 角色扮演模型:个性化的角色创作能力,更强的上下文感知和剧情推动能力,满足灵活的角色扮演需求;

豆包 · 语音合成模型:提供自然生动的语音合成能力,善于表达多种情绪,演绎多种场景;

豆包 · 声音复刻模型:5 秒即可实现声音 1:1 克隆,对音色相似度和自然度进行高度还原,支持声音的跨语种迁移;

豆包 · 语音识别模型:更高的准确率及灵敏度,更低的语音识别延迟,支持多语种的正确识别;

豆包 · 文生图模型:更精准的文字理解能力,图文匹配更准确,画面效果更优美,擅长对中国文化元素的创作;

豆包 · Function call 模型:提供更加准确的功能识别和参数抽取能力,适合复杂工具调用的场景;

豆包 · 向量化模型:聚焦向量检索的使用场景,为 LLM 知识库提供核心理解能力,支持多语言。

对于今天发布的豆包大模型家族,一位投资人认为,「字节不强调参数、不强调数据和语料,直接把模型能力在场景里做了垂直细分,这个决策因素是有应用和没有应用的区别,更本质的是有数据和没数据的区别。有用户反馈、有数据反馈,字节能够根据用户和数据的反馈去做更精准的场景和服务。」

就像移动互联网时代跑通的今日头条和抖音,字节在 AI 上,也是是数据逻辑,根据不同的数据链反馈,决定产品或者模型的下一步动作。相反,如果只做基础模型,不做服务升级,场景反馈、用户数据反馈会越来越少,模型能力的差别就会拉开。

02 豆包,如何承载「App 工厂」的大模型产品思路

其实早在去年,豆包大模型(原名:云雀)就在字节跳动内部完成了上线,其内部 50 多个业务也已经大量使用豆包大模型进行 AI 创新,包括抖音、番茄小说、飞书、巨量引擎等,用以提升效率和优化产品体验。

字节跳动也基于豆包大模型打造了一系列 AI 原生应用,包括 AI 对话助手「豆包」、AI 应用开发平台「扣子」、互动娱乐应用「猫箱」,以及星绘、即梦等 AI 创作工具。

其中,豆包和「扣子」,是字节跳动发力的主要产品。

根据 QuestMobile,基于豆包大模型同名打造的豆包 App,在苹果 App Store 和各大安卓应用市场,豆包 App 的下载量在 AIGC 类应用中排名第一。根据官方最新数据,豆包上已有超过 800 万个智能体被创建,月度活跃用户达到 2600 万。

字节跳动产品和战略副总裁 朱骏|图片来源:火山引擎

发布会上,字节产品战略负责人、Flow 部门朱骏,以豆包 App 为例,首次讲述了字节做 AI 原生应用的产品思路。他认为,和 AI 时代之前做产品设计比较,现在用户核心的需求没有改变,包括高效获取信息、工作提效、自我表达、社交娱乐等等。

差异点是,以前是在成熟的技术上想应用,只要用同理心去理解用户的需求和使用体验,就能做出一个还不错的产品。现在产品底下的技术不再是一个稳定的地基,大模型的能力在很多维度还有缺陷,同时又在快速演进,每隔三个月、半年都会发生很大的变化,甚至不是线性的渐进变化,而是突然跃迁。

因此,他认为做大模型应用一个很大的挑战是,在这个动态发展的过程中,先判断大模型现在能解决好什么任务,同时更重要的是要尝试预测半年、一年后大模型能把什么样的任务解决好。

以豆包 App 为例,他分享了字节对做大模型应用的思考。

拟人化

朱骏称,豆包的第一条产品设计原则是「拟人化」,这是大模型产品的新特性,自然语言新的交互方式,降低了使用门槛,也让用户在使用产品时感觉到产品有类似人的温度。为了体现这种拟人的感受,该款 APP 产品名字选用了「豆包」这样像亲密朋友日常称呼的昵称。

离用户近

豆包的第二条设计原则,离用户近。它要能随时伴随用户,嵌入用户的不同使用环境。「豆包到用户身边,而不是用户到豆包身边」。

一个例子在于语音交互入口的设计。为了让豆包在这种移动场景(比如户外)里交互更方便,像一个随身携带的百事通,字节很早投入了很大力度优化语音交互体验,包括基于大模型的 ASR 和超自然的 TTS 音色,尽量做到类似和一个真人对话的感受。豆包几乎是国内最早确立语音交互入口作为默认交互界面的大厂,后来语音交互入口也被加入了市面上其他大模型 APP。

个性化

第三个设计原则是「个性化」。虽然通用大模型能解决非常广泛的任务,但实际上,用户有自己个性化的需求,包括对智能体的功能定位,回答风格、声音、形象、记忆都有非常个性化的需求。

朱骏认为,未来用户大概率会有一个主要的智能体(比如豆包)做最高频的互动,解决很多任务;但是也会因为个性化、多样化的需要,和很多其他的智能体互动。

他总结称,「做大模型产品的挑战和乐趣是,需要在这种持续动态的技术发展中,不断去判断下一个产品的 PMF(产品市场匹配点)可能是什么。」

03 模型落地,火山引擎的基础设施

除了豆包大模型家族和字节的 AI 应用产品思路,在火山引擎发布会的主场上,大模型服务平台「火山方舟」也升级了多款插件和数据、营销、销售等 AI 应用服务。

在插件和工具链上,方舟 2.0 升级了联网插件,提供头条抖音同款搜索能力;升级内容插件,提供头条抖音同源海量内容;升级知识库插件,以提高搜索的相关性和准确性。

同时,火山方舟 2.0 也全面升级了底层基础设施。在系统承载力上,提供充沛的 GPU 算力资源,分钟级千卡扩缩容的超强弹性,保障业务稳定和成本可控;在安全防护上,通过安全沙箱构建可信的执行环境,多维度的安全架构,保障数据安全;此外,火山引擎提供专业的算法团队服务,帮助客户释放独有数据价值,落地大模型应用。

此外,针对大模型带来的基于自然语言的应用开发模式,火山引擎也推出了新一代 AI 应用开发平台——扣子专业版。

扣子产品经理潘宇扬介绍,扣子(coze)作为字节跳动推出的新一代 AI 应用开发平台,具备低门槛、个性化、实时性、多模态等优势,并集合海量的 AI 资源、丰富的发布 API 服务。

对于扣子,谭待认为「必须要一个扣子这样的低代码生态,应用的生态是一堆人的群体智慧,要能够让很多人以很低门槛做各种事情(AI 应用)。」

-

- 4块一杯,喜茶急了

-

2024-05-16 19:43:30

-

- iPad Pro 2024首发评测:轻且强,但空有一身好「武功」

-

2024-05-16 19:41:14

-

- 加速布局海外市场,雷鸟创新与谷歌达成合作

-

2024-05-15 01:47:55

-

- 听花酒调价!网友:为何不是查封

-

2024-05-15 01:45:39

-

- 网友曝李亚鹏拖欠工资,公开两人聊天记录,还不给员工缴纳社保

-

2024-05-15 01:43:23

-

- 平均“年龄”约140岁!我国已有中华老字号1455家

-

2024-05-15 01:41:08

-

- 佛山发布楼市新政13条,买房即可落户

-

2024-05-15 01:38:52

-

- 一票游三城!高铁旅游计次票再上新,怎么买?如何用?

-

2024-05-15 01:36:36

-

- 当前金价下还要“追高”吗?专家提醒黄金走势已有分歧 消费者不能盲目入市

-

2024-05-15 01:34:20

-

- 超长期特别国债来了!本周五首发,个人投资者能买吗?

-

2024-05-15 01:32:04

-

- 京东营销短信被大V炮轰,蓝月亮 “让妈妈先用”,为何母亲节营销老翻车?

-

2024-05-15 01:29:48

-

- 网友建议节假日高速免费延长至次日6时,交通运输部回应

-

2024-05-15 01:27:32

-

- 极氪赴美上市,李书福打出王牌

-

2024-05-13 17:17:55

-

- 成年人的“美丽刑具”,90天卖了一个亿?

-

2024-05-13 17:15:38

-

- 印度马上要超过美国,建成全球第二大地铁系统?

-

2024-05-13 17:13:22

-

- “迷幻药”大爆发

-

2024-05-13 17:11:05

-

- 年入86亿,70后温州人做跨境,雷军是其背后股东

-

2024-05-13 17:08:49

-

- 许斐、张剑慧晋升集团高管,小米管理团队更加多元

-

2024-05-13 17:06:31

-

- 自嘲“不会卖车”的魏建军,意欲“重铸”长城

-

2024-05-13 17:04:15

-

- 抖音打假,这类商家将被彻底封杀

-

2024-05-13 17:01:58

苹果Vision Pro,被华强北啃了

苹果Vision Pro,被华强北啃了 北京等地上空疑现不明飞行物!目击网友称“飞着飞着就没了”

北京等地上空疑现不明飞行物!目击网友称“飞着飞着就没了” 毛戈平7年IPO折戟,国货化妆品的出路在哪里

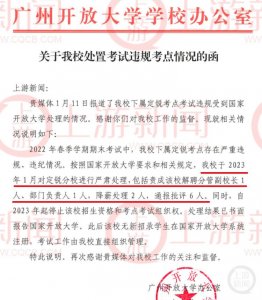

毛戈平7年IPO折戟,国货化妆品的出路在哪里 2831人考试2093人次替考!广州开放大学分管副校长解聘

2831人考试2093人次替考!广州开放大学分管副校长解聘 中产捧红的始祖鸟即将IPO,安踏捧出第二个“FILA”?

中产捧红的始祖鸟即将IPO,安踏捧出第二个“FILA”? 不想过年的年轻人,躲回工作中

不想过年的年轻人,躲回工作中 嘉行传媒还“行”不“行”?

嘉行传媒还“行”不“行”? 大模型浪潮不能使鬼推磨,但可以让周鸿祎、傅盛握手言和

大模型浪潮不能使鬼推磨,但可以让周鸿祎、傅盛握手言和 荣耀赵明:Magic6要在体验上超越iPhone而不是参数上

荣耀赵明:Magic6要在体验上超越iPhone而不是参数上 红薯原产地是哪个国家 红薯原产地是哪个国家或地区生产的

红薯原产地是哪个国家 红薯原产地是哪个国家或地区生产的